国内对标英伟达唯一具身智能——亿嘉和

展开

2024年2月24日,英伟达宣布成立通用具身智能体研究实验室GEAR,标志着英伟达正式入局具身智能领域的研究,加速人工智能具身化进程。机器人是具身智能的优良载体,英伟达GEAR实验室的联合创始人JimFan博士也在X平台上表示,2024年将是机器人、游戏AI、仿真之年,英伟达的入局有望加速机器人的发展,英伟达GTC上机器人相关的最新成果值得期待

华尔街见闻·见智研究认为:具身智能带来的AI价值远比人形机器人更大。具身智能最大的特质就是能够以主人公的视角去自主感知物理世界,用拟人化的思维路径去学,从而做出人类期待的行为反馈,而不是被动的等待数据投喂。在人类的五大感官中视觉获取的信息占比超过80%,并且让机器理解人类语言也是非常重要的,所以机器视觉和多模态大模型正是开启机器自我感知学的两把钥匙。

具身智能是什么?

具身智能简单来说就是AI的大脑加上躯体。它能够跟我们生活的环境进行交互,从而展现出智能行为。

而具身智能为什么被看作AI的iPhone时刻?

原来的人工智能可以看作第三人称的智能,也就是投喂数据给机器,让它学什么它就学什么。而现在具身智创造了一种机器自主学的新方式,能够以第一人称的视角来感知和学物理世界,并像人类一样理解和感知事物的能力,才能在此基础上进行相同思维的发展,最后表现出人类期待的行为方式。

Windows为何能统治操作系统,iPhone为何创造智能手机时代,最重要的原因就是他们创造了最简单、最直观的人机交互窗口。

发展人工智能的意义在于能够让机器造福人类,协助处理事务,提高生产力;更进一步则是让AI进行创造,推动科学研究的进展。而这一切的前提是:要让机器理解人类社会,要做到这一点,需要的就是具身智能。

见智研究认为:让AI拟人化的进行感知和理解世界方式,视觉和听觉是非常重要的。看见并理解物理世界中存在的事物,并且能够听懂人类的语言这背后需要的是机器视觉技术和多模态大模型。在具身智能领域的快速发展下,这两大领域的技术创新和需求也会与日俱增。

具身智能比人形机器人更有价值

具身智能相当于AI的大脑,而这个大脑的载体可以是任何形式。可以是一个机械臂,一只机器狗,更或者是一辆小汽车。

而反观人形机器人,当下为何被看做是一个不太聪明的钢铁巨人,核心还是因为缺少AI大脑+不太灵活的躯体。

就像马斯克所表示的,虽然未来有一天人人可能会拥有一个人形机器人,但是目前展现的Optimus人形机器人产品也就只能执行重复性的简单劳动。

见智研究认为:我们真正需要的人形机器人目前还缺少具身智能特质。马斯克也表示:未来会将特斯拉的视觉技术用于人形机器人的研发中。而对于具身智能和人形机器人所能够创造的价值,也非常明了了。具身智能的应用场景没有局限性,所以市场空间更广阔。

关注具身智能的硬实力

具身智能的硬实力包括:机器视觉和多模态大模型。

机器视觉是AI的感知工具,亦为数据生产的手段。在人类的五大感官中视觉获取的信息占比超过 80%。

机器视觉的端口是摄像头,作为看懂世界的“眼睛”;机器视觉的大脑是算法,承担分析功能。

见智研究认为:相比于单纯迭代硬件的参数指标,算法和架构的升级对于AI来说更重要。因为摄像头的发展目前已经可以实现对物体的数据采集,无论是清晰度还是色彩度都已经卷到了够用的程度。

值得关注的是,多模态大模型在机器领域的应用。无论是视觉图像信号还是人类语言的声音信号,最后都要转化为机器能够理解的语言,从而实现人机交互的目的。

$亿嘉和(sh603666)$亿嘉和

23年7月28号互动回复,在“机器人AI”领域积累了非常丰富的技术,包括视觉技术、自主导航技术、环境感知技术、AI算法技术、机器人控制技术。

12月7号,公司发布的一种基于多模态超融合技术的大模型YJH-LM,目前已在商用清洁机器人上完成功能测试。并且在人形机器人领域开展相关布局

公司还和腾讯,华为云合作相关机器人技术

完美对标英业达具身智能的技术要求

机器人视觉➕多模态Ai赋能,目前具身智能这块还没发酵,明天就开大会了。去年五月英伟达黄仁勋带火的具身智能概念还没真正炒作,这次大会我看预期方面就是这个。底部上来涨幅的不高,去年业绩增长1.3-1.5倍。周五已经有先手已经进场了,等周一发酵具身智能,有望开启连板

华尔街见闻·见智研究认为:具身智能带来的AI价值远比人形机器人更大。具身智能最大的特质就是能够以主人公的视角去自主感知物理世界,用拟人化的思维路径去学,从而做出人类期待的行为反馈,而不是被动的等待数据投喂。在人类的五大感官中视觉获取的信息占比超过80%,并且让机器理解人类语言也是非常重要的,所以机器视觉和多模态大模型正是开启机器自我感知学的两把钥匙。

具身智能是什么?

具身智能简单来说就是AI的大脑加上躯体。它能够跟我们生活的环境进行交互,从而展现出智能行为。

而具身智能为什么被看作AI的iPhone时刻?

原来的人工智能可以看作第三人称的智能,也就是投喂数据给机器,让它学什么它就学什么。而现在具身智创造了一种机器自主学的新方式,能够以第一人称的视角来感知和学物理世界,并像人类一样理解和感知事物的能力,才能在此基础上进行相同思维的发展,最后表现出人类期待的行为方式。

Windows为何能统治操作系统,iPhone为何创造智能手机时代,最重要的原因就是他们创造了最简单、最直观的人机交互窗口。

发展人工智能的意义在于能够让机器造福人类,协助处理事务,提高生产力;更进一步则是让AI进行创造,推动科学研究的进展。而这一切的前提是:要让机器理解人类社会,要做到这一点,需要的就是具身智能。

见智研究认为:让AI拟人化的进行感知和理解世界方式,视觉和听觉是非常重要的。看见并理解物理世界中存在的事物,并且能够听懂人类的语言这背后需要的是机器视觉技术和多模态大模型。在具身智能领域的快速发展下,这两大领域的技术创新和需求也会与日俱增。

具身智能比人形机器人更有价值

具身智能相当于AI的大脑,而这个大脑的载体可以是任何形式。可以是一个机械臂,一只机器狗,更或者是一辆小汽车。

而反观人形机器人,当下为何被看做是一个不太聪明的钢铁巨人,核心还是因为缺少AI大脑+不太灵活的躯体。

就像马斯克所表示的,虽然未来有一天人人可能会拥有一个人形机器人,但是目前展现的Optimus人形机器人产品也就只能执行重复性的简单劳动。

见智研究认为:我们真正需要的人形机器人目前还缺少具身智能特质。马斯克也表示:未来会将特斯拉的视觉技术用于人形机器人的研发中。而对于具身智能和人形机器人所能够创造的价值,也非常明了了。具身智能的应用场景没有局限性,所以市场空间更广阔。

关注具身智能的硬实力

具身智能的硬实力包括:机器视觉和多模态大模型。

机器视觉是AI的感知工具,亦为数据生产的手段。在人类的五大感官中视觉获取的信息占比超过 80%。

机器视觉的端口是摄像头,作为看懂世界的“眼睛”;机器视觉的大脑是算法,承担分析功能。

见智研究认为:相比于单纯迭代硬件的参数指标,算法和架构的升级对于AI来说更重要。因为摄像头的发展目前已经可以实现对物体的数据采集,无论是清晰度还是色彩度都已经卷到了够用的程度。

值得关注的是,多模态大模型在机器领域的应用。无论是视觉图像信号还是人类语言的声音信号,最后都要转化为机器能够理解的语言,从而实现人机交互的目的。

$亿嘉和(sh603666)$亿嘉和

23年7月28号互动回复,在“机器人AI”领域积累了非常丰富的技术,包括视觉技术、自主导航技术、环境感知技术、AI算法技术、机器人控制技术。

12月7号,公司发布的一种基于多模态超融合技术的大模型YJH-LM,目前已在商用清洁机器人上完成功能测试。并且在人形机器人领域开展相关布局

公司还和腾讯,华为云合作相关机器人技术

完美对标英业达具身智能的技术要求

机器人视觉➕多模态Ai赋能,目前具身智能这块还没发酵,明天就开大会了。去年五月英伟达黄仁勋带火的具身智能概念还没真正炒作,这次大会我看预期方面就是这个。底部上来涨幅的不高,去年业绩增长1.3-1.5倍。周五已经有先手已经进场了,等周一发酵具身智能,有望开启连板

话题与分类:

主题股票:

主题概念:

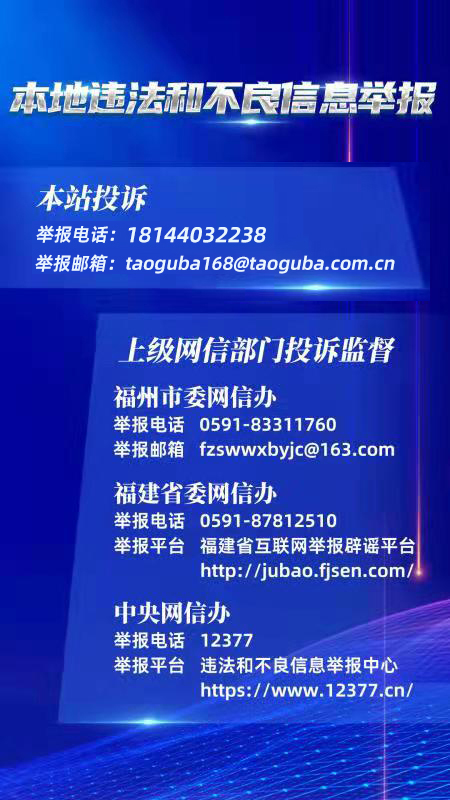

声明:遵守相关法律法规,所发内容承担法律责任,倡导理性交流,远离非法证券活动,共建和谐交流环境!

系统包括配置在机器人上的信息自组织核心神经网络和本体设备,所述信息自组织核心神经网络包括大语言模型、记忆模型、多模态感知模型和运动控制模型,本体设备包括驱动系统,机械系统和传感器系统等。本发明融合了不同特点的模型,能够充分感知用户数据和环境中的目标物、障碍物等信息,制定控制机器人运动和操作的执行策略,并基于仿真环境与现实环境感知反馈信息实时训练学调整,提高了机器人在现实环境中的人机交互体验和环境自适应能力,可以适用于不同类型的自主移动机器人和操作机器人,通用性强。

系统包括配置在机器人上的信息自组织核心神经网络和本体设备,所述信息自组织核心神经网络包括大语言模型、记忆模型、多模态感知模型和运动控制模型,本体设备包括驱动系统,机械系统和传感器系统等。本发明融合了不同特点的模型,能够充分感知用户数据和环境中的目标物、障碍物等信息,制定控制机器人运动和操作的执行策略,并基于仿真环境与现实环境感知反馈信息实时训练学调整,提高了机器人在现实环境中的人机交互体验和环境自适应能力,可以适用于不同类型的自主移动机器人和操作机器人,通用性强。

系统包括配置在机器人上的信息自组织核心神经网络和本体设备,所述信息自组织核心神经网络包括大语言模型、记忆模型、多模态感知模型和运动控制模型,本体设备包括驱动系统,机械系统和传感器系统等。本发明融合了不同特点的模型,能够充分感知用户数据和环境中的目标物、障碍物等信息,制定控制机器人运动和操作的执行策略,并基于仿真环境与现实环境感知反馈信息实时训练学调整,提高了机器人在现实环境中的人机交互体验和环境自适应能力,可以适用于不同类型的自主移动机器人和操作机器人,通用性强。